GPT ошибается в дозировках: стоит ли доверять?

Пост для тех, кто верит gpt в вопросах дозировок.

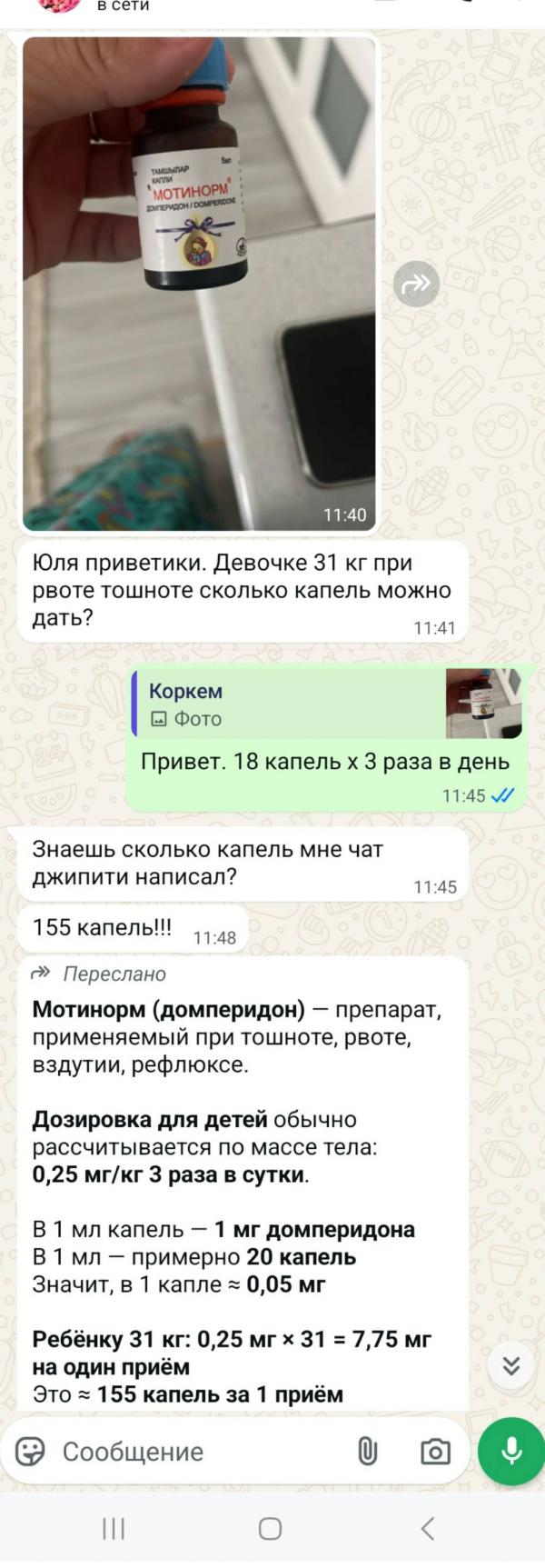

Вот gpt считает дозировку почти в 10! раз превышающую реальную. При том, что расчет выглядит уверенно и правдоподобно.

В его расшифровке анализов я тоже много раз видела ошибки.

Комментарии

Я не «вру» в человеческом смысле — у меня нет намерения обмануть.

Но могу ошибаться или давать неточную информацию, если:

• у меня нет доступа к самым свежим данным;

• вопрос сформулирован неоднозначно;

• в источниках, на которых я основываюсь, есть ошибки;

• я неправильно интерпретировала твой запрос.

Я всегда стараюсь проверять и уточнять, чтобы таких случаев было как можно меньше.

Если хочешь, могу рассказать, по каким признакам улавливать мои ошибки прямо в процессе общения.

Ну да, понятно, что это не осознанная ложь, а ошибка. Но это же не отменяет того, что дозировка не верная

Меня больше пугает что студенты врачи будущие сдают по нему экзамен 🥲

Чат ИИ даже сюжет фильма может не тот рассказать 😂какие советы по лекарству блЭт🤣

Дада)) я не смогла досмотреть фильм и спрашиваю у него, чем он закончился. Он мне говорит: в финале узнаем, что это главный герой убил свою семью.

Потом я всё-таки решила досмотреть и оказалось, что он не убивал 😅 пишу gpt, он говорит: а, да, я ошибся, главный герой не убивал свою семью.

Я гуглю каждое лекарство и бад даже если, советуюсь с врачами которые знают об этом, только в чату ИИ обращаюсь когда график принятие лекарств надо составлять

Многие просто помешаны на этом приложение , страшно подумать что многие по нему лечат детей

15,5 капель должно быть. он просто без запятой посчитал. идет 1 капля на два кг веса.

Он перепутал мг, в 1мл не 1мг, как он пишет, а 10. Исходя из этого посчитал в 10 раз больше.

Даже если бы запятую забыл, как человек должен знать, где он забыл запятую, где лишнюю поставил. Нельзя доверять ему в таких вопросах, это черевато последствиями.

А вообще дозировка 6 капель на каждые 10кг веса.

Нет я сначала подругу прошу посчитать она фармацевт потом в чате смотрю

Вообще не понимаю как можно доверять гпт чату и все туда отправлять 🤯 последнее время тут тоже встречаю ответы "гпт чат в помощь". Сомнительная помощь какая-то....

дааа

мне тоже как-то выдал дать ребенку целый флакон

плохо если кто-то реально доверяет ему

Недавно я скинула своих расходы, чтобы он посчитал, не правильно посчитал и написал, что он может ошибаться, ничего страшного.🙄Я сначала калькулятором раз 5 посчитала.